Éthique, sécurité et précautions d’usage de l’IA en éducation

Comment intégrer l’intelligence artificielle dans notre pratique enseignante de façon responsable, transparente et au service des apprentissages.

Je dois l’avouer : j’ai moi-même été prise par l’effet « Whaou » face aux capacités de l’IA générative. Comme beaucoup d’enseignants, j’ai été éblouie par les possibilités offertes par ces outils. Il m’a fallu du temps pour redescendre sur Terre.

Cet article me tient particulièrement à coeur. Il est le fruit d’un cheminement personnel et professionnel. Je remercie sincèrement toutes les personnes autour de moi qui ont su contenir mon enthousiasme initial et m’aider à prendre le recul nécessaire pour percevoir les zones d’ombre derrière cette technologie fascinante.

Vous trouverez ici un tour d’horizon des points de vigilance essentiels pour intégrer l’IA dans les pratiques pédagogiques, en toute conscience, et sans jamais perdre de vue la boussole éducative. Car c’est bien de cela qu’il s’agit : transformer notre fascination en sagesse pédagogique.

Afficher son usage de l’IA

Martine Peters, chercheuse à l’Université du Québec en Outaouais, a créé des icônes pour signaler de façon transparente l’utilisation de l’IA dans les contenus. Un réflexe simple à adopter dans vos publications professionnelles.

Icônes sous licence Creative Commons CC BY-NC-SA 4.0

NIA

Aucune intelligence artificielle n’a été utilisée pour créer ce contenu.

AIA

Ce contenu a été créé avec l’assistance de l’IA. L’humain reste aux commandes.

GIA

Ce contenu a été principalement généré par l’intelligence artificielle.

En pratique : vous pouvez intégrer ces icônes dans vos documents de classe, vos présentations ou vos supports de formation. C’est un moyen concret de modéliser la transparence auprès de vos collègues et de vos élèves.

Mes principes pour une IA éthique en classe

Ces quatre principes guident mon utilisation de l’IA, que ce soit pour préparer mes cours ou pour créer les ressources de ce site.

Transparence

Je signale clairement quand j’utilise l’IA. Mes collègues et mes élèves ont le droit de savoir comment les contenus sont produits.

Vérification

L’IA peut se tromper (on parle d’hallucinations). Chaque information générée est relue, vérifiée et croisée avec des sources fiables avant d’être partagée.

Responsabilité

L’IA est un outil, pas un auteur. Je reste responsable de ce que je publie et de ce que je propose à mes élèves. L’expertise pédagogique reste humaine.

Complémentarité

L’IA ne remplace pas mon expertise pédagogique. Elle m’aide à gagner du temps sur certaines tâches pour me concentrer sur l’essentiel : la relation avec mes élèves.

Sur ce site, je suis AIA

Mon processus de création se fait en deux temps. D’abord un travail de réflexion 100 % humain, puis l’IA intervient comme outil d’aide.

Étape 1 — Sans IA

- Brainstorming et génération d’idées

- Brouillon et plan initial

- Réflexion pédagogique sur le fond

Étape 2 — Avec l’IA

- Aide à la structuration et reformulation

- Mise en page et code HTML/CSS

- Suggestions d’amélioration

Dans tous les cas

- Aucune génération de contenu « brut » publié tel quel

- Relecture et adaptation à mon contexte de classe

- Vérification systématique des informations et des sources

Citer ses sources : utiliser ChatGPT pour un texte ou Redmenta pour un quiz, c’est très bien. Mais il faut mentionner l’origine du contenu généré. L’enseignant garde la responsabilité intellectuelle de ce qu’il propose. Exemple : « Ce texte a été généré à partir d’une proposition de ChatGPT (OpenAI), puis adapté, relu et validé par l’autrice. »

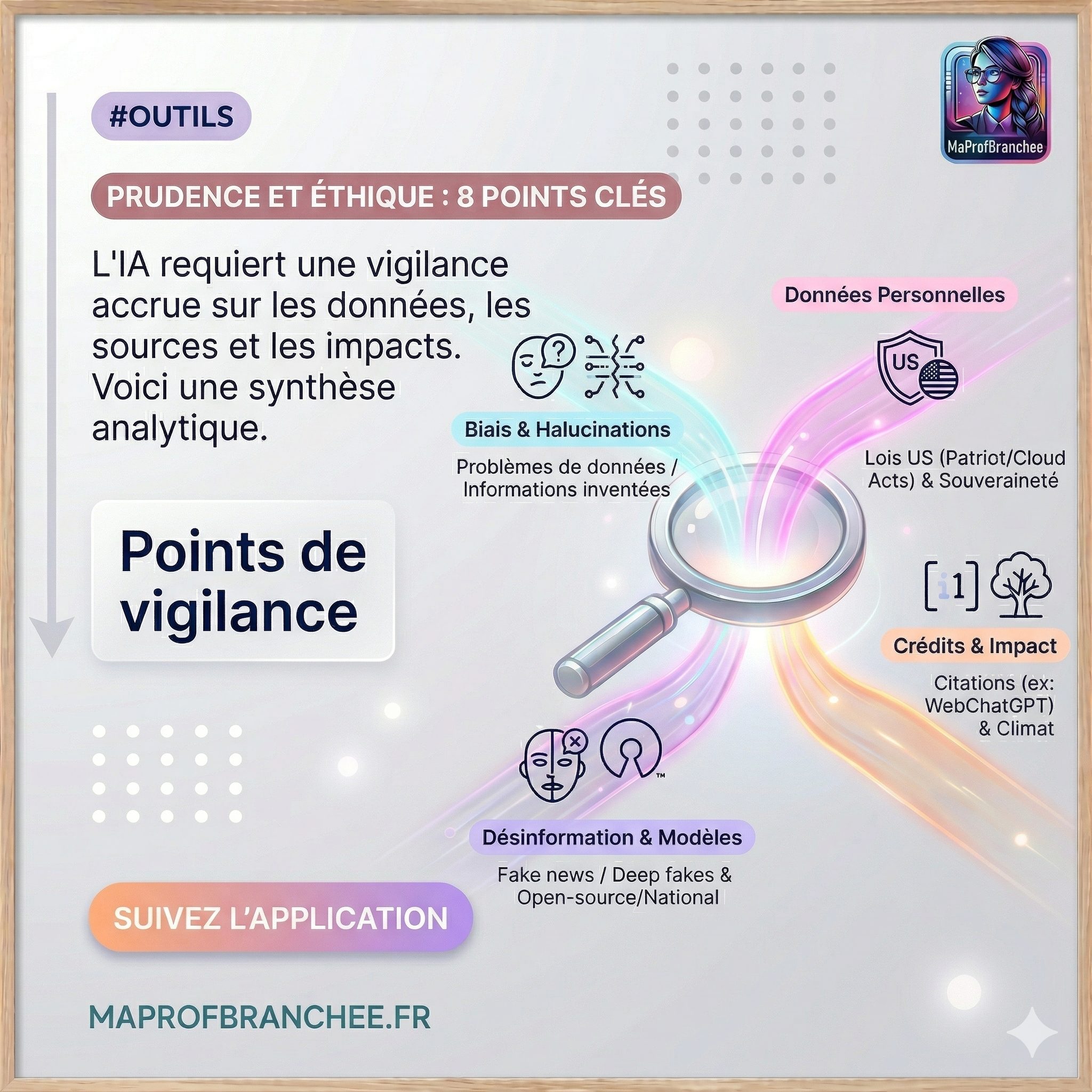

Les risques à connaître

Avant d’intégrer l’IA dans vos pratiques, il est indispensable d’en connaître les limites. Voici les cinq domaines de vigilance essentiels.

L’IA est entraînée sur des données biaisées

Quand une IA donne une réponse, elle s’appuie sur des millions de textes préexistants. Le souci : ces textes peuvent véhiculer des stéréotypes (sexistes, validistes, culturels…). Les systèmes d’IA peuvent reproduire et amplifier ces discriminations dans l’évaluation des élèves, les recommandations pédagogiques, la sélection de ressources ou l’orientation scolaire.

Réflexe à adopter : analysez une réponse d’IA avec vos élèves. Y a-t-il des idées préconçues ? Qui est inclus ? Qui est oublié ? C’est une activité EMI (éducation aux médias et à l’information) très concrète.

Une IA peut halluciner

C’est le terme utilisé pour désigner une IA qui invente une réponse qui semble crédible mais qui est totalement fausse : une date d’événement inventée, une loi citée qui n’existe pas, un lien vers un article inexistant. L’IA n’a jamais été entraînée à distinguer le vrai du faux. Internet regorgeant de fausses informations, elle peut reproduire des tentatives de manipulation, des avis de personnes incompétentes ou des certitudes sans fondement.

Ce que je recommande : vérifiez toujours les informations importantes. Utilisez des outils qui intègrent la recherche web vérifiable (comme Perplexity). Initiez vos élèves à la vérification croisée des sources : c’est une compétence numérique essentielle.

Données personnelles : terrain sensible

Alerte : Sam Altman, patron d’OpenAI, a reconnu publiquement en juillet 2025 (podcast « This Past Weekend w/Theo Von », juillet 2025) l’absence de protection juridique pour les échanges avec ChatGPT. Il a confirmé qu’OpenAI pourrait être tenu de produire les conversations en cas de procédure judiciaire. Contrairement aux professions à secret (médecin, avocat), aucun cadre légal ne protège vos échanges avec une IA.

Ce qu’on peut faire en toute sécurité : utiliser des IA validées par l’Éducation nationale, anonymiser systématiquement les données, privilégier les solutions conformes au RGPD et les outils souverains. La règle d’or : « Ne partagez jamais avec une IA ce que vous ne diriez pas en public. »

Désinformation et deep fakes

Une IA peut créer de fausses informations crédibles, des images truquées, voire des vidéos montées de toutes pièces. En classe, apprenez à repérer les indices d’un contenu fabriqué, organisez des jeux de détection de fake news générées par IA et travaillez sur la cybercitoyenneté : vérifier avant de partager, prendre du recul, identifier la source.

Pour aller plus loin : la lutte contre la désinformation s’inscrit dans une démarche plus large de littératie numérique. Consulter mon article « Pourquoi le numérique à l’école ? »

L’IA a une empreinte carbone

C’est un sujet souvent oublié : derrière chaque requête IA se cache un serveur puissant, énergivore, parfois situé à l’autre bout du monde. Un usage frugal est recommandé : utiliser l’IA quand elle fait gagner du temps, soutient l’inclusion ou améliore l’expérience pédagogique. Pas pour chaque virgule.

Idée de séquence : une carte mentale sur « le coût invisible du numérique » ou un débat : « Faut-il limiter l’usage de l’IA à l’école ? »

Préserver l’autonomie et développer l’esprit critique

L’IA ne remplace pas l’humain. Pour en tirer le meilleur, il faut préserver l’autonomie professionnelle et former les élèves à un usage critique.

Préserver l’agentivité enseignante

L’utilisation de l’IA pour la préparation de cours peut entraîner une diminution des échanges entre collègues et du travail en collégialité. La recherche recommande de préserver la capacité des enseignants à prendre eux-mêmes des décisions pédagogiques.

Trois pistes concrètes : utiliser l’IA pour améliorer l’information décisionnelle plutôt que prendre des décisions éducatives ; l’utiliser pour des rétroactions formatives (pas pour l’évaluation certificative) ; privilégier les usages qui engagent les élèves dans un recul critique.

Les 5 étapes d’un usage critique de l’IA

La recherche (Allouche, 2023) propose un modèle concret pour enseigner l’usage critique de l’IA :

- Amorce : s’interroger avant de produire

- Instruction : questionner et concevoir sa demande

- Analyse : structurer et évaluer la réponse obtenue

- Vérification : consulter des sources externes complémentaires

- Bilan : analyser les biais et impacts de l’interaction

Message clé pour les élèves : « Tu as utilisé intelligemment l’IA, c’est bien. » Cette validation positive encourage l’usage réflexif plutôt que l’interdiction.

Attention à l’effet « confident numérique »

Les utilisateurs développent une relation d’intimité avec les IA conversationnelles, oubliant l’absence de protection juridique. Le sentiment de « conversation privée » est trompeur et peut mener à un partage progressif d’informations personnelles.

Idées d’activités : jeu de rôle « IA détective » (montrer comment reconstituer un profil à partir d’échanges), exercice d’anonymisation (réécrire des questions personnelles de manière neutre), débat « Faut-il traiter l’IA comme un ami ou comme un outil ? »

Le cadre institutionnel et juridique

Depuis 2024-2025, un cadre réglementaire se structure en France et en Europe. Voici les repères essentiels à connaître.

En France : le cadre d’usage de juin 2025

Le cadre d’usage de l’IA en éducation, publié le 14 juin 2025 par le ministère de l’Éducation nationale, est le fruit d’une large consultation nationale. Il autorise l’usage de l’IA en éducation dès lors qu’il respecte les valeurs de l’École, le RGPD, la loi SREN et le règlement européen sur l’IA.

À l’école primaire : les élèves sont sensibilisés aux principes de base de l’IA, mais ne manipulent pas directement de services d’IA générative. L’usage pédagogique par les élèves est autorisé à partir de la 4e, exclusivement en classe et accompagné par l’enseignant.

Pour les enseignants : l’IA peut soutenir la préparation de cours, l’aide à l’évaluation et la simplification de tâches administratives. Les outils libres et souverains sont à privilégier. Les services grand public sont tolérés à condition de n’y saisir aucune donnée personnelle ni sensible.

À retenir : un usage frugal est recommandé (l’IA uniquement en cas de plus-value avérée), avec une vigilance particulière sur les biais, les hallucinations, la propriété intellectuelle et l’impact environnemental. Consulter le texte officiel | Mon analyse détaillée

En Europe : l’AI Act et la Convention-cadre

Le règlement européen sur l’IA (AI Act), entré en vigueur le 1er août 2024 (publication au Journal officiel de l’UE le 12 juillet 2024), introduit des interdictions spécifiques en éducation : inférence d’émotions interdite en classe (sauf raisons médicales), notation sociale des élèves, manipulation comportementale cognitive. Les systèmes d’admission, d’évaluation scolaire et d’allocation de ressources éducatives sont classés « à haut risque » avec des obligations renforcées.

Le Conseil de l’Europe a également adopté le 17 mai 2024 la première convention-cadre internationale juridiquement contraignante sur l’IA, ouverte à signature le 5 septembre 2024. Elle est ancrée dans les droits humains, la transparence, la non-discrimination et l’état de droit.

Les 6 domaines de vigilance identifiés par la recherche

Protection des données

Minimisation, base légale, DPIA obligatoire pour les enfants.

Biais et discrimination

Surveillance des performances différenciées selon les profils d’élèves.

Transparence

Information sur l’usage d’IA, supervision humaine obligatoire.

Sûreté technique

Robustesse et sécurité des modèles utilisés en contexte éducatif.

Intégrité académique

Gestion des hallucinations, vérification humaine systématique.

Droits de l’enfant

Principe « child-rights by design » dans tout projet IA scolaire.

Convergence internationale : les cadres français, européen et international convergent sur 4 principes : approche centrée humain avec supervision systématique, protection renforcée des données des élèves, formation des enseignants à la littératie IA, transparence et information des familles.

Conseils pour vos premiers pas

Quelques repères simples pour intégrer l’IA dans votre pratique de façon progressive et responsable.

Le passage de la fascination à la sagesse pédagogique nécessite du temps, de la formation et une réflexion collective. Le chemin passe par l’émerveillement initial, la prise de recul, la formation aux enjeux techniques et éthiques, puis un usage réfléchi au quotidien. L’IA peut proposer, suggérer, accélérer… mais c’est toujours l’humain qui choisit, valide et accompagne.

Commencez par la préparation

Utilisez l’IA pour générer des idées d’activités, reformuler des consignes ou créer des exercices différenciés. C’est le meilleur point d’entrée, sans impact direct sur les élèves.

Vérifiez toujours

L’IA peut inventer des références, commettre des erreurs factuelles ou produire des contenus biaisés. Croisez systématiquement avec des sources institutionnelles (Éduscol, Canopé, CNIL).

Protégez les données

Ne saisissez jamais de données personnelles d’élèves dans un outil d’IA générative grand public. Privilégiez les solutions conformes au RGPD et les outils souverains.

Partagez votre démarche

Expliquez à vos collègues et aux familles comment vous utilisez l’IA. La transparence est la meilleure façon de construire la confiance autour de ces nouveaux outils.

Checklist : intégrer l’IA de façon éthique

Une synthèse des bonnes pratiques à vérifier avant tout projet d’intégration de l’IA dans votre classe ou votre établissement.

En classe

- Former les élèves à l’esprit critique numérique

- Supervision humaine systématique des contenus générés

- Double vérification des informations produites par l’IA

- Attribution et citation obligatoires des outils utilisés

- Consignes claires sur les usages autorisés et interdits

- Adapter l’évaluation : privilégier les productions processuelles

Données et conformité

- Protéger les données personnelles à chaque étape

- Anonymiser systématiquement toutes les données saisies

- Privilégier les outils conçus pour l’éducation

- Hébergement UE privilégié pour les données sensibles

- Information claire des familles et des élèves

- Vérifier la conformité RGPD et AI Act

Garder le contrôle, toujours : l’IA peut devenir une alliée dans les pratiques pédagogiques, à condition de prendre le temps de réfléchir, tester, ajuster… et de partager ses expériences entre collègues (et ses doutes aussi). Créez des documents « avant/après IA » pour montrer l’évolution du travail et gardez un carnet de bord pour noter ce qui fonctionne, ou pas.